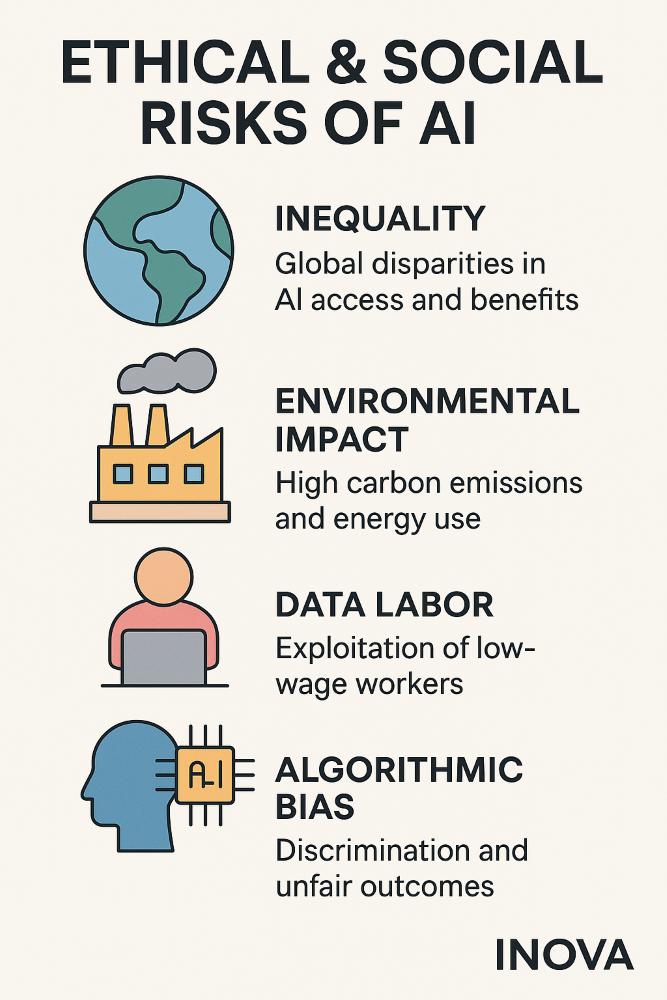

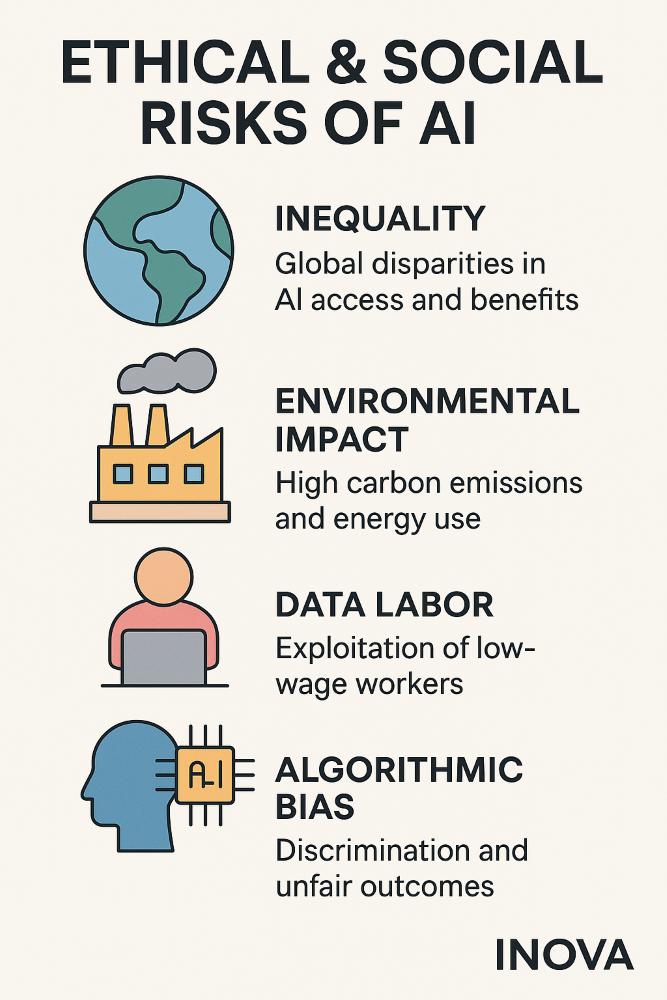

- 디지털 불평등·탄소발자국·데이터 착취 논쟁 확산

AI의 급속한 확산이 전 세계적 디지털 격차와 기술 종속 문제를 심화시키고 있다. 특히 개발도상국은 AI 인프라와 데이터 접근성 부족으로 ‘기술 식민주의(technological colonialism)’ 위험에 노출돼 있으며, 대규모 AI 모델의 에너지 소비와 환경 부담도 주요 윤리 쟁점으로 부상하고 있다.

《AP 통신》과 《가디언》에 따르면, 파리에서 열린 AI Action Summit 2025에서 전문가들은 “AI가 경제적 부의 재분배를 촉진하기는커녕, 오히려 선진국 중심의 기술 집중을 심화시키고 있다”고 지적했다.

현재 글로벌 AI 컴퓨팅 자원의 80% 이상이 북미와 유럽에 집중돼 있으며, 아프리카·남아시아 지역은 AI 연구 및 상용화 인프라가 현저히 부족하다.

또한 대형 AI 모델의 학습 과정에서 발생하는 탄소 배출량과 전력 소비량이 지속가능성 논의의 중심으로 떠오르고 있다.

MIT 연구팀에 따르면 GPT-4급 모델의 학습에만 약 50만 kg의 탄소 배출량이 발생하며, 이는 내연기관 자동차 100대가 1년 동안 배출하는 양과 맞먹는다.

일부 전문가는 “AI 혁신이 환경적 지속 가능성을 무시하고 있다는 점에서, 새로운 형태의 산업시대적 착취 구조를 재현하고 있다”고 경고했다.

데이터 착취와 노동 불평등

AI 생태계의 불평등은 단순히 하드웨어 수준을 넘어 데이터 노동(data labor) 문제로 확산되고 있다.

예를 들어, 대형 모델 훈련에 필요한 데이터 정제·태깅 작업은 케냐·필리핀 등 저소득 국가의 노동자들이 주로 수행하며, 시간당 임금이 1달러 미만인 경우도 많다.

이는 “AI가 보이지 않는 인적 노동 위에 세워진 디지털 제국”이라는 비판을 낳고 있다.

“AI는 편견 없는 기술이 아니라, 인간 사회의 불균형을 증폭시키는 거울이 될 수 있다.

공정한 AI를 위해선 기술적 접근성뿐 아니라, 데이터 정의(data justice) 개념이 필요하다.”

— Dr. Timnit Gebru, DAIR Institute 설립자

국제 연구기관 OECD AI Observatory 도 최근 보고서에서, AI 개발 및 배포 단계에서의 윤리적 표준화, 환경 데이터 공개, 공공 이익 기반의 기술 이전 제도를 도입할 것을 제안했다.

사회적 리스크 요약

구분 | 주요 리스크 | 파급 영향 |

|---|

경제적 | 기술 종속, 인프라 격차 | 글로벌 성장 불균형 심화 |

환경적 | 탄소 배출, 전력 소비 | 지속가능성 훼손 |

노동적 | 데이터 노동 착취 | 사회적 불평등 확대 |

문화적 | 알고리즘 편향 | 문화 다양성 약화 및 사회 갈등 |

시사점

정책적 측면: AI 개발 단계부터 윤리 영향평가(AI Ethics Impact Assessment) 의무화 필요.

산업적 측면: 지속 가능한 AI(Sustainable AI) 설계가 기업 경쟁력의 새로운 기준으로 부상.

사회적 측면: 데이터 주권, 공정한 접근성, 알고리즘 투명성 확보가 핵심 과제.

국제협력 측면: 선진국 중심 AI 구조를 완화하기 위한 글로벌 데이터 협약 필요.

[보도출처: AP News – “AI risks widening global inequality, climate crisis warned at Paris Summit” The Guardian – “AI could worsen inequality and climate crisis, warn experts at AI Action Summit”]

태그: #윤리 #AI위험 #기술식민주의 #데이터정의 #지속가능AI #디지털불평등 #AI윤리 #환경영향

AI 혁신 물결: xAI의 세계 모델, OpenAI GPT-5 업데이트, Hugging Face 오픈소스 NLP 모델 출시

2025년 말, AI 분야에서 주요 기업들의 연이은 발표가 이어지며 기술 발전의 속도가 가속화되고 있다. xAI의 로보틱스용 물리 세계 이해 모델 개발, OpenAI의 GPT-5 시리즈 업데이트, 그리고 Hugging Face의 맞춤형 NLP 오픈소스 모델 출시가 그 중심에 있다. 이러한 발전은 로보틱스, 자연어 처리, 콘텐츠 생성 등 다양한 영역에서 실용적 적용을 촉진할 ...

AI 혁신 물결: xAI의 세계 모델, OpenAI GPT-5 업데이트, Hugging Face 오픈소스 NLP 모델 출시

2025년 말, AI 분야에서 주요 기업들의 연이은 발표가 이어지며 기술 발전의 속도가 가속화되고 있다. xAI의 로보틱스용 물리 세계 이해 모델 개발, OpenAI의 GPT-5 시리즈 업데이트, 그리고 Hugging Face의 맞춤형 NLP 오픈소스 모델 출시가 그 중심에 있다. 이러한 발전은 로보틱스, 자연어 처리, 콘텐츠 생성 등 다양한 영역에서 실용적 적용을 촉진할 ...

서울국제조각페스타 2026, 코엑스서 예술과 기업의 만남 성황

서울국제조각페스타 2026, 코엑스서 예술과 기업의 만남 성황

[손현식 칼럼] 270만 외국인 시대, ‘함께 사는 법’은 배운 적이 없다

[손현식 칼럼] 270만 외국인 시대, ‘함께 사는 법’은 배운 적이 없다

할리우드 배우노조, 스튜디오 측에 새 반대 제안 테이블에 올리다

할리우드 배우노조, 스튜디오 측에 새 반대 제안 테이블에 올리다

하나님의 축복 속에서 시작된 사랑… 특별한 결혼의 여정

하나님의 축복 속에서 시작된 사랑… 특별한 결혼의 여정

목록

목록